Regulierung von Künstlicher Intelligenz in Kalifornien: Gesetzesvorschlag und Auswirkungen

Während die USA insgesamt Künstliche Intelligenz bisher nicht reguliert haben, hat der Bundesstaat Kalifornien jetzt ein KI-Sicherheitsgesetz verabschiedet. Für Unternehmen könnte sich einiges ändern.

Wie gefährlich Künstliche Intelligenz (KI) werden kann, darüber wird viel diskutiert. Der US-Bundesstaat Kalifornien, in dem sehr viele KI-Unternehmen sitzen, will jetzt auf Nummer sicher gehen. Ein neues Gesetz soll verhindern, dass KI-Systeme außer Kontrolle geraten können.

Zwar muss der Gouverneur von Kalifornien noch zustimmen. Wenn das aber passiert ist, könnte das Folgen haben für die großen kalifornischen KI-Unternehmen wie Google, Meta oder OpenAI. Das ist auch der Grund, warum sie sich seit Monaten gegen die neuen Regeln wehren. Ziel des Gesetzes: Risiken verringern

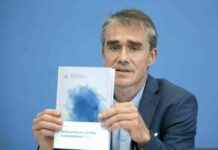

„Wir wollen das Risiko verringern“, sagt Scott Wiener. Er vertritt San Francisco im Senat von Kalifornien und hat das KI-Gesetz mitgeschrieben. Er meint Risiken, die durch KI verursacht werden könnten. Zum Beispiel Stromausfälle, Angriffe auf das Bankensystem oder die Entwicklung von Biowaffen.

Wenn Whistleblower vor möglichen Gefahren durch Künstliche Intelligenzen warnen, sollen die durch das Gesetz besser geschützt werden. Ziel sei es nicht, die KI-Entwicklungen zu stoppen. KI-Systeme werden aber immer leistungsfähiger. Deshalb wolle man die Kontrolle behalten, bevor etwas passiert.

„Wir haben das zum Beispiel bei Social-Media-Firmen gesehen. Die haben sich entwickelt, wir haben einfach zugesehen und mussten dann hinterherrennen“, so Wiener.

Sprachmodelle sollen reguliert werden

Beim Gesetz geht es vor allem um die Regulierung sehr großer Sprachmodelle, die mit riesigen Datenmengen gefüttert wurden. Groß bedeutet: Die Entwicklung muss mindestens 100 Millionen Dollar gekostet haben. Zum Beispiel: Das neueste GPT-Modell von OpenAI oder Gemini von Google.

Wenn das Gesetz in Kraft tritt, müssten diese Modelle dann vor der Veröffentlichung verpflichtend getestet werden. Auch kalifornische Behörden hätten mehr Einfluss. Der Generalstaatsanwalt könnte KI-Firmen verklagen, wenn zum Beispiel durch die Verwendung von KI Menschen zu Schaden kommen.

Sollte eine KI außer Kontrolle geraten, muss die Firma in der Lage sein, sie schnell abzuschalten. Das Gesetz verlangt sozusagen eine Art „Notausknopf“.

Was sind Sprachmodelle?

Sprachmodelle ermöglichen es KI-Bots, wie Chat-GPT, sehr schnell, menschenähnliche Texte zu schreiben. Sie können aber auch Bilder oder Computercodes generieren. Nutzende müssen dafür nur einen Textbefehl – einen sogenannten Prompt – eintippen.

Sorge: Entwickler könnten Kalifornien verlassen

Seit Monaten wird über das Gesetz diskutiert. Gegenwind gibt es zum Beispiel aus der demokratischen Partei, obwohl diese in Kalifornien regiert. Eine große politische Sorge: Entwickler und Firmen könnten Kalifornien verlassen, um KI in anderen Bundesstaaten zu entwickeln.

Ähnlich argumentieren auch die KI-Firmen selbst. Sie sagen: Das neue Gesetz gefährde die Wettbewerbsfähigkeit der USA. Wenn Regulierung, dann müsste es sie in den gesamten Vereinigten Staaten geben.

Denn: Das Gesetz würde alle Firmen betreffen, die in Kalifornien Geschäfte machen. Es reiche also nicht, so die Kritiker, wenn sie einfach ihren Hauptsitz innerhalb der USA verlegen. Sie müssten komplett auf Geschäfte mit den fast 40 Millionen Bewohnern Kaliforniens verzichten.

Auch Google und seine KI-Angebote wären von dem Gesetz betroffen.

Eine weitere Sorge der Tech-Konzerne betrifft sogenannte Open-Source-Modelle. Die können Entwickler weltweit und kostenlos nutzen, das lässt sich kaum kontrollieren. Firmen wie Meta fürchten, sie könnten für Anwendungen, die mit ihren Modellen entwickelt werden, haftbar gemacht werden.

Das Gesetz wurde nach der Kritik an mehreren Stellen abgeschwächt. Zum Beispiel wurden die Standards angehoben, ab wann sich KI-Firmen an die neuen Regeln halten müssen. Anderen gehen die nicht weit genug – sie halten Formulierungen im Gesetz für zu vage.

Auch Zustimmung zum Gesetz

Obwohl viele Unternehmen das Sicherheitsgesetz ablehnen, sind auch einige KI-Pioniere für eine Regulierung. So wie Sam Altman, Chef von OpenAI. „Wir halten staatliche Regulierung für nötig, um Risiken zu minimieren“, sagte Altman bereits im vergangenen Jahr vor dem US-Kongress. Das kalifornische KI-Gesetz könnte zum Vorbild für die ganzen USA werden, sagt er.

Zustimmung kommt auch von bekannten KI-Forschern wie Geoffrey Hinten oder auch von Elon Musk. Der Tech-Milliardär hat mit xAI eine eigene KI-Firma. In einem Post schreibt er: „Seit über 20 Jahren setze ich mich für die Regulierung von KI ein. So wie wir jede Technologie regulieren, die ein potenzielles Risiko für die Öffentlichkeit darstellt.“

Bevor das Gesetz aber in Kraft treten kann, muss der kalifornische Gouverneur, Gavin Newsom, noch zustimmen. Er könnte auch noch ein Veto einlegen. Bisher hat er sich nicht dazu geäußert, wie er zum Gesetz steht.

Die Auswirkungen des Gesetzes auf die KI-Branche

Das neue KI-Sicherheitsgesetz in Kalifornien hat weitreichende Auswirkungen auf die KI-Branche in den USA und darüber hinaus. Unternehmen wie Google, Meta und OpenAI stehen vor neuen Herausforderungen und müssen ihre Arbeitsweise möglicherweise anpassen, um den neuen Regulierungen gerecht zu werden.

Durch die Verpflichtung zur Regulierung großer Sprachmodelle und die Einführung von Kontrollmechanismen wie einem „Notausknopf“ werden KI-Unternehmen gezwungen, mehr Verantwortung zu übernehmen und sicherzustellen, dass ihre Technologien sicher und ethisch einwandfrei sind.

Die Diskussionen und Debatten um das Gesetz zeigen, dass die Regulierung von KI ein komplexes Thema ist, das viele verschiedene Interessen und Standpunkte berührt. Es bleibt abzuwarten, wie sich die Situation weiterentwickeln wird und ob das kalifornische Gesetz tatsächlich zum Vorbild für andere Bundesstaaten oder sogar für die gesamten USA wird.